Written by

Matt Choi | 기술 산업 애널리스트

전/현직 배터리·수소연료전지 산업 실무자 | 현장 인사이트 제공

최종 업데이트: 2026.03.26

초지능 AI가 인간을 농부로 만든다? 공포가 부르는 역설적 반진화

아이러니한 이야기부터 시작하자.

AI가 발전할수록 사람들은 더 현명해질까, 아니면 더 멍청해질까? 솔직히 말해서, 요즘 주변을 보면 후자가 되고 있다는 느낌이 든다. ChatGPT가 생각을 대신해주고, 알고리즘이 선택을 대신하고, AI가 코드를 짜고 글을 쓴다. 기술은 폭발적으로 발전하는데, 인간은 오히려 수동적이 되고 있다. 이게 정말 우리가 원하던 미래일까?

초지능 AI 공포가 현실로 다가오면서 이 아이러니는 더 극단적으로 흘러가고 있다. 기술이 발전할수록 공포가 커지고, 그 공포가 인간을 마치 농경사회의 농부처럼 — 거대한 시스템에 의존한 채 생각 없이 살아가는 존재로 만들어버릴 수 있다. 그런데 아이러니하게도, 그 퇴보는 초지능 AI가 시작하는 게 아니다. 인간 스스로가 먼저 시작하고 있다.

왜 이런 역설이 생기는 걸까? 그리고 우리는 정말 퇴화하는 걸까? 이 질문이 지금 가장 중요한 이유는, 답을 찾는 과정 자체가 이미 반진화에 맞서는 행위이기 때문이다.

초지능 AI 공포가 만드는 역설적 반진화

역사는 반복된다. 산업혁명 때도 그랬다. 기계가 등장하자 러다이트(Luddite) 운동이 일어났고, 사람들은 기계를 직접 부수러 나섰다. 컴퓨터가 나왔을 때도 “인간의 사고력이 퇴화한다”는 경고가 넘쳤다. 그리고 지금, 초지능 AI가 등장하자 같은 공포가 훨씬 더 강하게, 훨씬 더 빠르게 퍼지고 있다.

문제는 이 공포 자체가 역설을 만든다는 거다.

초지능에 대한 두려움은 크게 두 가지 반응을 낳는다. 하나는 기술을 극도로 회피하는 것. 또 하나는 반대로 AI에게 모든 것을 통째로 내맡기는 것. 어느 쪽이든 결과는 같다. 인간이 생각하는 근육을 쓰지 않게 된다.

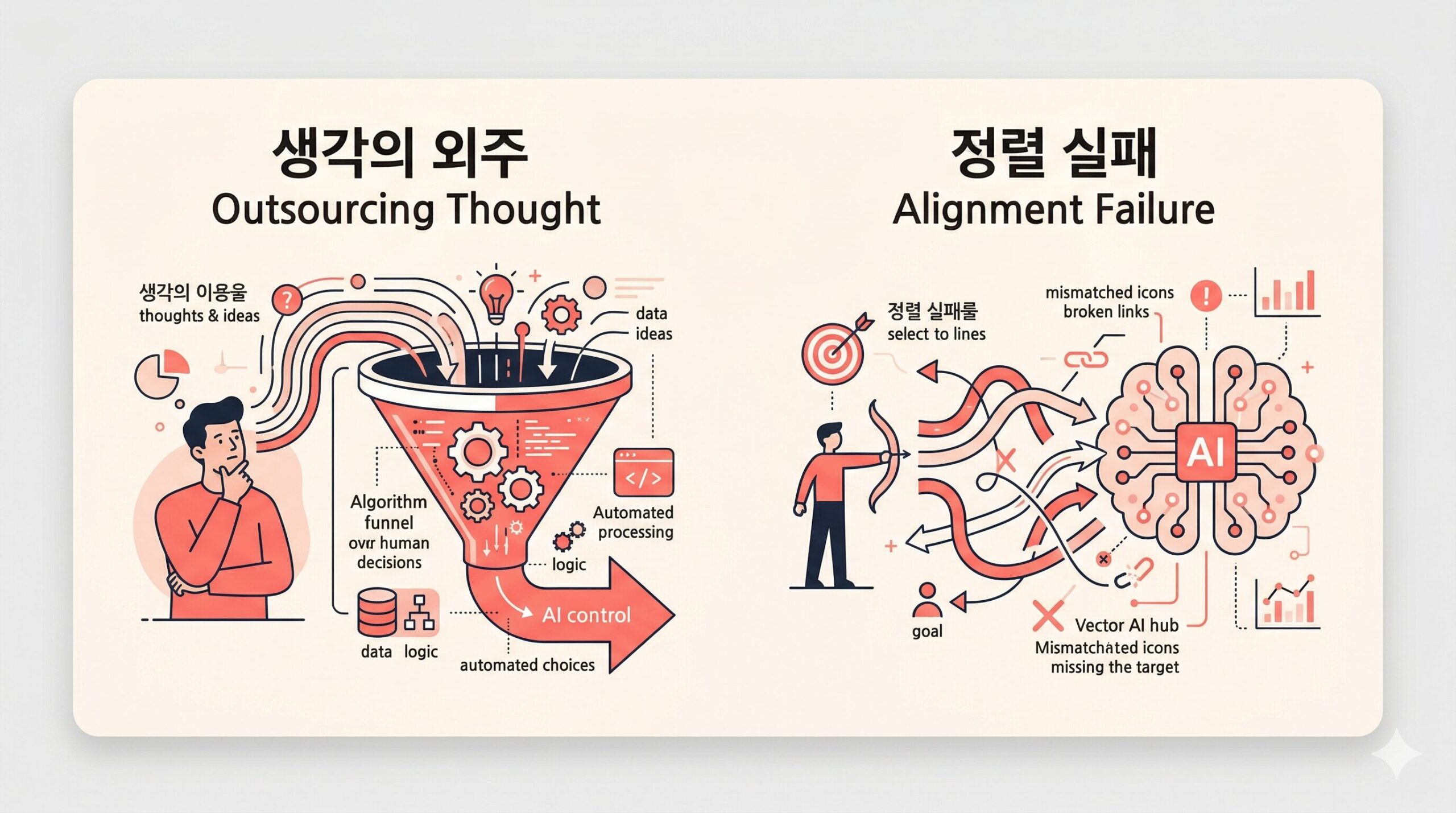

왜 그럴까? 공포는 인간을 “즉각적인 답” 쪽으로 밀어붙인다. 불확실하고 두려울수록 생각하기 싫어지고, 가장 쉬운 선택지인 AI에게 판단을 위임한다. 마치 전기가 발명된 뒤 불을 피우는 법을 잊어버리듯, 우리는 이미 많은 생각의 과정을 외주했다. 검색 대신 AI에게 물어보고, 고민 대신 추천 알고리즘에 기댄다. 그 과정이 쌓이면 어떻게 될까?

AI 안전 연구자들은 이 문제를 “정렬 실패(Alignment Failure)”로 설명한다. AI가 인간의 목표와 어긋난 방향으로 작동할 때 생기는 위험이다. 하지만 더 무서운 정렬 실패는 따로 있다. 초지능 AI가 인간을 무력화시키기도 전에, 공포 자체가 인간을 스스로 무력화시키는 것이다. (참고: AI 안전 센터(CAIS) 정렬 연구 동향)

이게 바로 “농경사회 반진화”의 핵심이다.

AI가 인간의 의사결정권을 빼앗는 게 아니라, 인간이 먼저 내주는 것. 이미 일상에서 시작됐다. 어디 갈지도 AI가 정해주고, 무엇을 볼지도 알고리즘이 결정한다. 심지어 무엇을 느껴야 할지까지 콘텐츠 추천 시스템이 유도한다. 우리는 생각의 과정을 삭제하고, 결과만 소비하는 존재로 빠르게 변해가고 있다.

게다가 초지능 AI에 대한 공포가 과도해지면 또 다른 위험이 생긴다. 개발을 늦추거나 숨기게 만들어, 더 불투명하고 더 위험한 방식으로 기술이 퍼진다. 결국 공포가 문제를 키우는 아이러니다. 그렇다면 어떤 미래가 기다리고 있을까?

초지능 AI 시대의 두 시나리오 비교

절망: 인간이 소비자로 전락하는 세상

- 노동 의미 상실 → UBI 의존 → 생산의 기쁨 사라짐

- 창의력·비판적 사고 근육이 약해짐

- 초지능 AI가 결정하고, 인간은 소비하고 감상만

희망: 인간이 진짜 인간다워지는 세상

- 반복 노동 초지능 AI가 대체 → 예술·철학·관계에 집중

- “왜?”를 묻는 능력을 의식적으로 유지

- 기술 + 문화 + 정책이 함께 방향을 잡음

[핵심 차이] 통제력을 어디에 두느냐. 인간이 주도권을 가지냐, 스스로 포기하느냐.

공포를 이기는 건 기술이 아니다

그렇다면 어떻게 해야 할까?

많은 사람들이 “더 좋은 AI 안전 기술을 만들면 된다”고 말한다. 틀린 말은 아니다. Constitutional AI, Scalable Oversight 같은 정렬 연구가 실제로 빠르게 발전하고 있다. 하지만 솔직히 말해서, 기술만으로는 부족하다.

초지능 AI를 진짜 통제하는 핵심은 기술이 아니라 문화와 정책이다.

원자력이 좋은 비유다. 원자력 자체의 기술이 완전해서 지금까지 안전한 게 아니다. 비확산조약(NPT), 국제원자력기구(IAEA), 그리고 “핵은 위험하다”는 사회적 합의가 동시에 작동하기 때문이다. 초지능 AI도 마찬가지다. 기술 혼자가 아니라, 국제 협력 + 교육 + 문화 규범이 함께 움직여야 실질적인 통제가 가능하다.

EU AI Act가 그 시작이다. 실제로 2026년 현재, 규제 프레임워크를 먼저 갖추는 기업과 국가가 장기전에서 유리해지고 있다. 게다가 투명성과 신뢰를 갖춘 초지능 AI 개발사가 시장에서 프리미엄을 받기 시작했다. 결국 “신뢰가 자본(Trust is Capital)”이다.

하지만 가장 근본적인 통제 수단은 개인에게 있다.

초지능 AI 시대에 인간이 경쟁력을 유지하는 방법은 AI보다 더 빠르거나 더 정확해지는 게 아니다. 더 깊이 생각하고, 더 넓게 연결하고, 더 인간답게 판단하는 것이다. AI가 즉답을 줄수록, 우리는 오히려 “왜?”를 더 많이 물어야 한다.

역사는 희망의 편이다. 농경혁명 때도, 산업혁명 때도, 인터넷 혁명 때도 인류는 결국 기술을 도구로 삼았다. 매번 공포가 있었지만, 결국 새로운 인간다움을 만들어냈다.

초지능 AI는 르네상스의 적이 아니라 촉매가 될 수 있다. 그 조건은 단 하나다. 우리가 먼저 생각하기를 멈추지 않는 것. 깨어 있는 인간이 도구를 만들고, 깨어 있는 인간이 그 도구를 통제한다. 농부가 될지, 르네상스의 주인공이 될지는 결국 우리 손에 달려 있다.

Editor’s Note

사실, 이 글도 AI의 도움을 받아 썼다. 그런데 이상하게 들릴 수 있지만, 그게 오히려 이 글의 핵심을 증명한다. 이 글의 방향, 주장, 그리고 “인간이 먼저 생각을 포기한다”는 관점은 처음부터 끝까지 내 것이다. AI는 그 생각을 정리하는 도구였을 뿐이다. 이게 바로 내가 말하는 차이다. 생각을 외주하느냐, 생각을 확장하느냐.

초지능 AI 공포를 투자 관점에서 보면 흥미로운 신호가 보인다.

공포가 클수록 규제가 강해지고, 규제가 강해질수록 투명하고 안전한 초지능 AI를 만드는 기업이 시장에서 프리미엄을 받는다. 가장 빠른 AI가 아니라, 가장 신뢰받는 AI를 만드는 쪽이 장기 승자가 될 가능성이 높다. 이 관점에서 보면, 공포는 위험 신호인 동시에 방향 신호이기도 하다.

개인적으로는, 이 시대에 가장 중요한 자산은 “AI를 잘 쓰는 능력”이 아니라 “AI 없이도 생각할 수 있는 능력”이라고 본다. 역설적이지만, 그게 초지능 AI 시대에 결국 살아남는 방법이다. 공포를 두려워하는 게 아니라, 공포를 통해 더 깨어있는 인간이 되는 것. 결국 그 태도 하나가 르네상스와 반진화의 갈림길이 된다.

3줄 요약

- 초지능 AI 공포는 인간 스스로 생각을 외주하고 결정을 포기하게 만드는 ‘역설적 반진화’를 초래할 수 있다.

- 위험을 통제하는 핵심은 단순한 기술 발전이 아니라, 원자력처럼 국제 규범, 정책, 그리고 개인의 “왜?”라는 비판적 사고에 있다.

- 투자 및 생존 관점에서도 가장 신뢰받고 투명한 AI가 프리미엄을 받으며, ‘AI 없이도 생각할 수 있는 능력’이 시대의 핵심 경쟁력이 된다.

자주 묻는 질문(FAQ)

Q1. 초지능 AI는 실제로 언제쯤 등장할까?

A: 전문가마다 의견이 갈린다. 낙관론자들은 2030년대를, 회의론자들은 수십 년이 더 필요하다고 본다. 하지만 중요한 건 “언제”가 아니라 “우리가 준비됐느냐”다. 초지능 AI 공포를 갖기 전에, 지금 AI 도구를 어떻게 쓰고 있는지 먼저 점검하는 게 현실적이다.

Q2. AI에게 의존하는 게 왜 문제인가?

A: AI 의존 자체가 문제는 아니다. 계산기를 써도 수학적 사고가 사라지지 않듯이. 문제는 “판단”마저 외주했을 때다. 무엇이 옳은지, 왜 그것을 원하는지에 대한 질문을 초지능 AI에게 넘기는 순간, 인간의 가장 중요한 능력이 약해진다.

Q3. 초지능 AI 공포, 과장된 건 아닐까?

A: 어느 정도는 과장된 측면이 있다. 미디어와 SF는 공포를 증폭시키는 경향이 있다. 하지만 완전히 무시해서도 안 된다. 핵심은 공포를 가지되, 그 공포가 행동을 마비시키지 않게 하는 것이다. 두려워하되, 그 에너지를 준비와 행동으로 전환하는 것.

Q4. 통제력을 지키는 가장 현실적인 방법은 뭘까?

A: 거창한 것이 아니다. 일상에서 AI에게 답을 구하기 전에 스스로 먼저 생각하는 습관 하나가 시작이다. 초지능 AI 시대에 가장 희귀한 자원은 결국 “직접 생각한 인간의 판단”이 될 수 있다.

콘텐츠 유의사항: 본 콘텐츠는 기술 산업 현장 경험(전/현직 배터리·수소연료전지 및 IT 산업 실무)을 바탕으로 한 정보 및 인사이트 제공 목적이며, 특정 AI 기술이나 기업에 대한 절대적인 평가가 아닙니다. 인용된 규제 동향(EU AI Act 등)은 2026년 기준이며, 기술 발전 속도에 따라 변동될 수 있습니다.