데이터센터 액체 냉각: 120kW 블랙웰 한계 돌파 – Vertiv 분석

데이터센터 액체 냉각 시스템이 AI 혁명의 지속 가능성을 결정지을 최후의 인프라로 떠올랐다.

데이터센터가 뜨겁다. 문자 그대로 뜨겁다. 엔비디아(Nvidia) 블랙웰 GB200 랙(Rack) 하나가 120kW를 소비한다. 이 열을 제대로 빼내지 못하면 서버가 멈추고 화재가 발생하며, 데이터센터 자체가 작동 불능 상태에 빠진다.

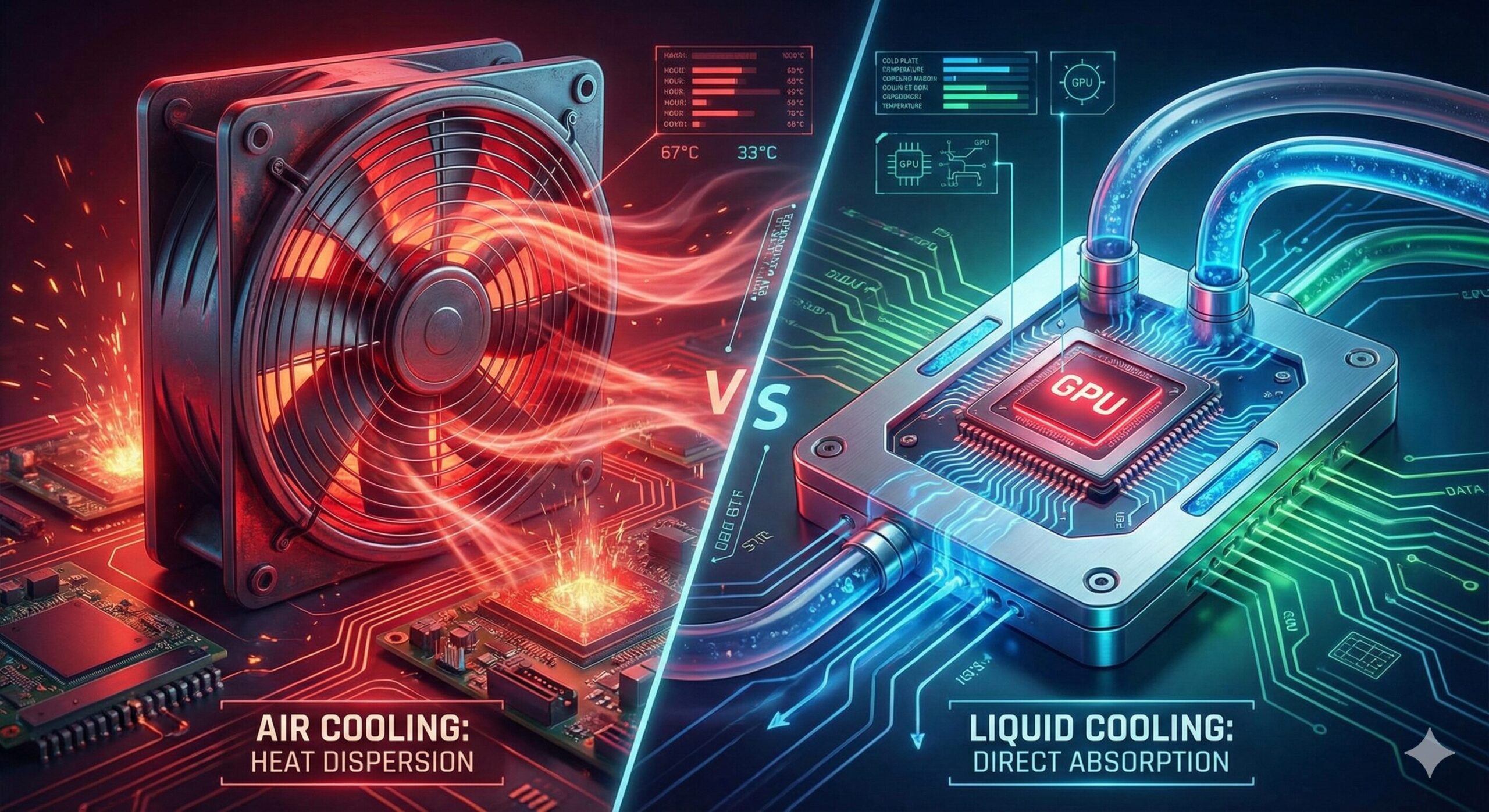

기존 방식으로는 안 된다. 에어컨과 팬으로 서버를 식히는 공랭(Air Cooling) 방식은 랙당 최대 20~30kW 수준이 한계다. 120kW짜리 랙을 공랭으로 식히는 건 선풍기로 용광로를 식히는 것과 같다. 물리적으로 불가능하다.

그래서 나온 것이 차세대 데이터센터 액체 냉각(Liquid Cooling) 기술이다. 물이나 특수 냉각액을 칩 가까이 직접 흘려 열을 빼는 방식이다. AI 가속기의 밀도가 폭발적으로 증가하면서 이 시스템은 이제 선택이 아닌 필수가 됐다. 이 글에서는 왜 공랭이 한계에 부딪혔는지, 기술적 차이가 무엇인지, 그리고 Vertiv·Schneider·Modine이 이 시장을 어떻게 공략하고 있는지 데이터를 통해 뜯어본다. 데이터센터 혁명 시리즈 4편, 냉각 전쟁이 시작된다.

공랭으로는 왜 안 되나? – 데이터센터 액체 냉각의 필수성

솔직히 처음엔 의문이었다. 에어컨을 더 강하게 틀면 안 되나? 결론부터 말하자면 안 된다.

공기는 열을 옮기는 능력이 물보다 훨씬 약하다. 물의 열용량은 공기의 약 4,000배다. 같은 양의 열을 빼내려면 공기는 물보다 4,000배 더 많이 흘려야 한다는 뜻이다. 120kW 랙에서 나오는 열을 공기로만 빼내려면 허리케인 수준의 바람이 필요하다. 현실적으로 불가능하다.

게다가 문제가 더 있다. 공랭 방식은 차가운 공기를 앞에서 불어넣고 더운 공기를 뒤로 빼는 구조다. 랙 밀도가 높아질수록 뜨거운 공기가 다시 차가운 공기 쪽으로 섞이는 열 순환 현상이 발생한다. 이걸 ‘핫스팟(Hotspot)’이라고 한다. 특정 서버가 과열되는 것을 막으려면 데이터센터 전체 온도를 무리하게 낮춰야 하며, 이는 냉방 비용의 폭발로 이어진다.

비유하자면 공랭식 인프라는 선풍기를 트는 여름 사무실이다. 사람이 많아질수록 더워지고, 선풍기를 아무리 늘려도 한계가 온다. 결국 각자의 책상(칩) 바로 옆에 붙어 있는 개인용 에어컨, 즉 데이터센터 액체 냉각 솔루션이 필요해진다.

실제로 기존 인프라 전력의 30~40%가 냉방에 쓰인다. 이를 액체 냉각으로 전환하면 이 비율이 10~15%까지 떨어진다. 연간 수백만 달러의 전력 비용 절감이 발생하므로, 하이퍼스케일러(Hyperscaler)들이 앞다퉈 신규 설계를 전환하고 있다.

냉각 시스템 세대별 핵심 데이터 비교

- 냉각 매체: 공기

- 최대 냉각 밀도: 20~30kW/rack

- 냉방 비용: 전체 전력의 30~40%

- 설치 복잡도: 낮음

- AI 가속기 적합성: Blackwell 이상 랙에서 불가

- 냉각 매체: 물·특수 냉각액·불소계 액체

- 최대 냉각 밀도: 100kW~200kW/rack 이상

- 냉방 비용: 전체 전력의 10~15%

- 설치 복잡도: 높음 (배관·전용 인프라 필요)

- AI 가속기 적합성: Blackwell·Rubin 랙 필수 탑재

핵심 차이: 이 기술 없이는 차세대 AI 가속기 랙의 물리적 운용이 원천적으로 불가능하다.

Vertiv·Schneider·Modine, 데이터센터 액체 냉각 시장을 누가 가져가나

방식마다 쓰임새가 다르고, 기업들의 전략 포지션도 뚜렷하게 나뉜다. 주요 냉각 방식은 크게 세 가지다. 칩 바로 위에 냉각판을 붙이는 직접 액체 냉각(DLC), 서버 전체를 특수 냉각액에 담그는 침수 냉각(Immersion Cooling), 그리고 랙 뒷면에 열교환기를 다는 후면 도어 냉각이다.

주요 기업 포지셔닝:

- Vertiv(버티브): 전원·냉각·IT 인프라를 모두 다루는 종합 기업이다. 엔비디아 블랙웰 랙용 DLC 솔루션을 공동 개발할 만큼 협력 관계가 깊으며, 인프라 전체를 원스톱으로 공급하는 강점을 지녔다.

- Schneider Electric(슈나이더 일렉트릭): 에너지 관리와 자동화 분야의 글로벌 선두로, PUE(전력 사용 효율) 최적화에 초점을 맞추며 유럽의 탄소 중립 요구 수요를 흡수하고 있다.

- Modine Manufacturing(모딘): 자동차·산업용 열교환기 기술을 데이터센터에 적용하며 시장에 빠르게 진입 중인 열 관리 전문 기업이다. 상대적으로 저평가된 틈새 다크호스다.

투자 인사이트 및 리스크 팩터

글로벌 데이터센터 액체 냉각 시장은 2026년 약 50억 달러에서 2030년 200억 달러 이상으로 연평균 40% 이상 성장할 전망이다. AI 가속기 밀도가 높아질수록 이 성장세는 가팔라진다.

특히 주목할 것은 OCP(Open Compute Project) 규격화 논의와 함께 엔비디아가 블랙웰 랙 설계에 DLC를 기본 채택한 점이다. 사실상 시장 표준이 강제되면서 Vertiv, Schneider 등의 밸류에이션(Valuation) 구조가 전면 재평가되고 있다. 국내에서는 SK D&D 등 계열사들이 리트로핏(Retrofit, 사후 개조) 수주를 본격화하고 있다.

주요 리스크 팩터(Risk Factor):

- 레거시 전환 비용: 기존 공랭 설비를 개조하는 리트로핏 비용(배관, 서버 교체)이 막대하여 점진적 교체가 이뤄질 수밖에 없다.

- 누수 리스크: 직접 액체 냉각(DLC)의 경우 서버 내부 배관 누수 시 치명적인 손실을 초래하므로 신뢰성 확보가 최우선 과제다.

- 표준화 부재: 벤더마다 연결 규격이 달라 호환성 문제가 발생할 수 있다.

- AI Capex 둔화: 하이퍼스케일러의 데이터센터 투자가 꺾이면 선투자한 냉각 인프라 업체들의 실적이 요동칠 수 있다.

자주 묻는 질문 (FAQ)

Q1. 데이터센터 액체 냉각 시스템이란 무엇인가요?

A: 공기 대신 물이나 냉각액을 이용해 칩의 열을 직접 제거하는 기술입니다. 물의 열용량이 공기의 4,000배라 100kW 이상의 고밀도 발열 환경에서 필수적인 인프라로 자리 잡았습니다.

Q2. 직접 액체 냉각(DLC)과 침수 냉각의 차이는?

A: DLC는 칩 위에 냉각판을 붙이고 배관으로 액체를 순환시키는 방식(엔비디아 블랙웰 권장)이며, 침수 냉각은 전기가 통하지 않는 특수 불소계 액체에 서버 전체를 담그는 초고효율 방식입니다.

Q3. 기존 공랭식 설비도 개조가 가능한가요?

A: 가능합니다. 이를 리트로핏(Retrofit)이라고 하며, 후면 도어 열교환기 방식을 주로 활용합니다. 다만 비용이 커서 신규 증설분부터 전면 도입하는 추세가 더 강합니다.

Editor’s Note

숫자를 보면 방향은 명확하다. 데이터센터 냉방 비용이 전체 전력의 30~40%에서 10~15%로 줄어드는 것, 이게 데이터센터 액체 냉각 전환의 핵심 동인이다. 개인적으로 이 시장에서 가장 흥미로운 포인트는 엔비디아의 역할이다. 랙 설계 표준에 이를 포함시킨 것은 단순한 기술 선택이 아니라 시장 방향을 강제한 것이다. 엔비디아가 가리키는 곳에 인프라 수요가 따라온다는 공식이 작동 중이다. 다음 편은 광 인터커넥트다. GPU 클러스터가 수만 개 규모로 커지면서 구리 케이블이 한계에 왔다. 빛으로 데이터를 보내는 시대가 열리고 있다.

- Problem (문제): AI 서버 랙당 소비 전력이 120kW(블랙웰 기준)를 넘어서면서 기존 공랭 방식의 열 수용 한계점(20~30kW)을 물리적으로 초과함.

- Strategy (전략): 공기보다 열용량이 4,000배 뛰어난 액체를 칩에 직접 순환시키는 데이터센터 액체 냉각 시스템이 엔비디아의 차세대 표준 인프라로 채택됨.

- Opportunity (기회): 연평균 40% 이상 성장하는 글로벌 냉각 시장에서 원스톱 인프라 구축 강자인 Vertiv, 에너지 효율에 특화된 Schneider 등의 밸류에이션 재평가 가속화.